نگاهی به استفاده از هوش مصنوعی و تحلیل داده ها در جنگ و تجاوز 12 روزه اسرائیل علیه ایران

فناوری های نوین که قرار بود به زندگی بشر سرعت، دقت و رفاه بیشتری ببخشد، امروز در بسیاری از میدانهای نبرد به ابزاری برای سرکوب و نابودی مردمان بیگناه و بی دفاع بدل شده است. مرور تاریخ جنگها نشان میدهد هر بار که فناوری تازهای مانند هوش مصنوعی پا به عرصه گذاشته، پیش از آنکه در خدمت انسان قرار گیرد، به ابزار مرگ و کشتار کشورهای مدعی دارای قدرت و تکنولوژی تبدیل شده است. از بمب اتمی آمریکا در هیروشیما تا استفاده از فسفر سفید در غزه؛ و اکنون، الگوریتمها و مدلهای هوش مصنوعی در تجاوز ۱۲ روزه اخیر اسرائیل علیه ایران

فناوری؛ فرصت یا تهدید؟

قرن 21 شاهد انفجار دانش در حوزههایی چون نانو، کوانتوم، بیوتکنولوژی، هوافضا، تکنولوژی اطلاعات و بهویژه هوش مصنوعی است. این فناوریها به شکل گسترده در اقتصاد، بهداشت، آموزش و حتی زندگی روزمره انسان ها نفوذ کردهاند. اما همین دستاوردها، اگر بیقانون و افسارگسیخته رها شوند، میتوانند مرگبارتر از هر سلاح کلاسیک باشند.

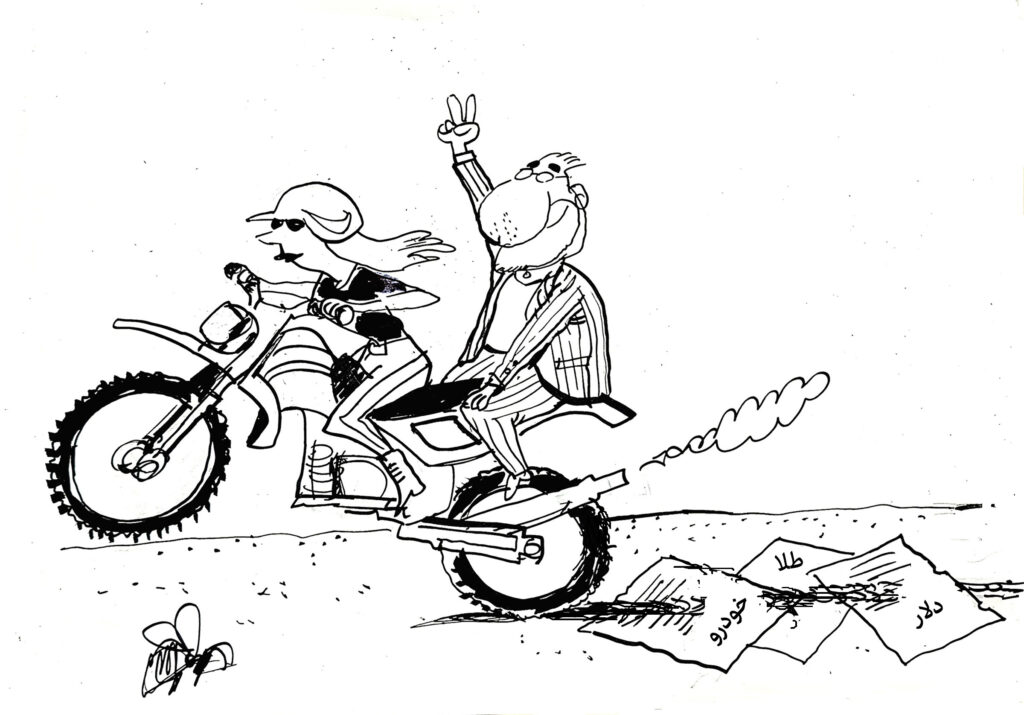

نمونه روشن آن، حملات اسرائیل در جنگ ۱۲ روزه اخیر به ایران است که بهطور مستقیم از الگوریتمهای هوش مصنوعی برای ردیابی، شناسایی و ترور فرماندهان و دانشمندان ایرانی بهره گرفت. دادههای جمعآوریشده از تلفنهای همراه، شبکههای اجتماعی و رفتار کاربران، خوراک الگوریتمهایی شد که در نهایت محل اقامت و تردد نخبگان علمی ایران را مشخص و آنها را به همراه خانواده و فرزندان خردسالشان بطور مظلومانه ای در نیمه های شب به شهادت رساند. برای نمونه این قهرمانان و نخبگان علمی میتوان به دکتر محمد مهدی طهرانچی، عضو هیئت علمی و استاد ممتاز دانشکده فیزیک دانشگاه شهید بهشتی و رئیس بزرگترین دانشگاه غرب آسیا (دانشگاه آزاد اسلامی) اشاره کرد.

روایت یک تراژدی

بر اساس گزارشهای مستند، در این تهاجم، دهها استاد دانشگاه، فرمانده نظامی و دانشجوی نخبه، همراه با خانوادههایشان، هدف قرار گرفتند. پهپادهای هوشمند با استفاده از مدلهای هوش مصنوعی، منازل، خودروها و حتی مسیرهای رفتوآمد را رصد کرده و حملات دقیق و مرگباری را ترتیب دادند.

این نخبهکشی یادآور تاریخ خونینی است که در آن فناوریهای روز، به جای ساختن، برای ویران کردن به کار گرفته شدهاند:

1 بمباران اتمی هیروشیما و ناگازاکی توسط آمریکا (۱۹۴۵)

2 استفاده از «عامل نارنجی Agent Orange » و آفتکشها در ویتنام توسط آمریکا (۱۹۶۱ تا ۱۹۷۱)

3 بازداشت و بازجویی و شکنجه افراد پس از حادثه ۱۱ سپتامبر2001 در آمریکا با روش های مبتنی بر تکنولوژی های روز

4 پروژههای محرمانه آزمایشی بر انسان (MK-Ultra) در آمریکا در دهه (1950 و1960)

5 استفاده از پهپادها برای شناسایی وحمله از فاصلههای دور درکشورهای پاکستان، یمن،سومالی،افغانستان، لبنان، عراق ( 2001)

و اکنون، اسرائیل با حمایت ایالات متحده آمریکا با کمک هوش مصنوعی همان مسیر را ادامه داده است.

جنگ الگوریتمها

برخلاف جنگهای کلاسیک، نبردهای امروز «شبکهمحور» و «اطلاعاتمحور» هستند. هوش مصنوعی، با توان پردازش بلادرنگ دادهها، میدان جنگ را بازتعریف کرده است. پهپادهای هوشمند، موشکهای برنامه ریزی شده و سامانههای رهگیری مبتنی بر الگوریتم، تنها بخشی از این پازل مرگبارند. رژیم صهیونیستی با بهرهگیری از پلتفرمهایی مانند Azure AI مایکروسافت، اطلاعات جمعآوریشده توسط جاسوسان انسانی از جمله مکالمات رهگیریشده و ترجمه آنها را با سرعت تحلیل می کند. اسرائیل در این جنگ از سامانههایی چون «لاوندر» و «گاسپل» استفاده کرد که قادر بودند روزانه صدها هدف انسانی را شناسایی کنند. این سامانهها حتی از طریق تلفنهای همراه و سیگنالهای اینترنتی، فرماندهان را در لحظه ورود به خانه رهگیری کرده و به پهپادها دستور حمله بدهند.

ضرورت قانونگذاری جهانی در AI

تجاوز به ایران و جنایات اسرائیلی ها در غزه بار دیگر زنگ خطر را به صدا درآورده است. آیا میتوان به فناوریای که مرز میان ابزار دفاعی و سلاح مرگ را از بین برده، بیتفاوت بود؟ هوش مصنوعی نظامی باید تابع قواعد شفاف بینالمللی باشد. همانگونه که برای سلاحهای شیمیایی و هستهای کنوانسیونهای جهانی تدوین شد، امروز نیز جامعه جهانی نیازمند توافقی تازه برای مهار «سلاحهای هوشمند الگوریتمی» است.

سازمانهای بینالمللی– از سازمان ملل گرفته تا نهادهای حقوق بشری – که متاسفانه برده های امپریالیسم جهانی شده اند، وکشورهای دنیا و حاکمانش نباید تنها ناظر خاموش باشند. سکوت امروز، فردا به معنای مشروعیتبخشی به نخبهکشی و نسلکشی فناورانه است.

سخن پایانی

هوش مصنوعی میتواند جهان را به سوی رفاه و عدالت پیش ببرد، اما اگر افسار آن در دست قدرتهای سلطهگر بماند، به هیولایی بدل خواهد شد که مرزهای اخلاق و انسانیت را در هم میشکند. ایران در این جنگ ۱۲ روزه قربانی مستقیم این هیولا بود؛ اما این تهدید محدود به ایران یا فلسطین نیست. این سرنوشت محتوم همه جوامعی است که برای استفاده درست از فناوریهای نوین، قانون، اخلاق و همبستگی جهانی را جدی نگیرند. آینده جنگها نه در میدان، که در کدها و الگوریتمها رقم میخورد؛ و این همان خطری است که بشر باید همین امروز برای مهارش چارهای بیندیشد.